新澳门六合彩开奖网址 陈丹琦团队降本大法又来了:数据砍掉三分之一,性能却完全不减

陈丹琦团队又带着他们的降本大法来了——新澳门六合彩开奖网址

数据砍掉三分之一,大模子性能却完全不减。

他们引入了元数据,加速了大模子预考试的同期,也不加多单独的狡计支出。

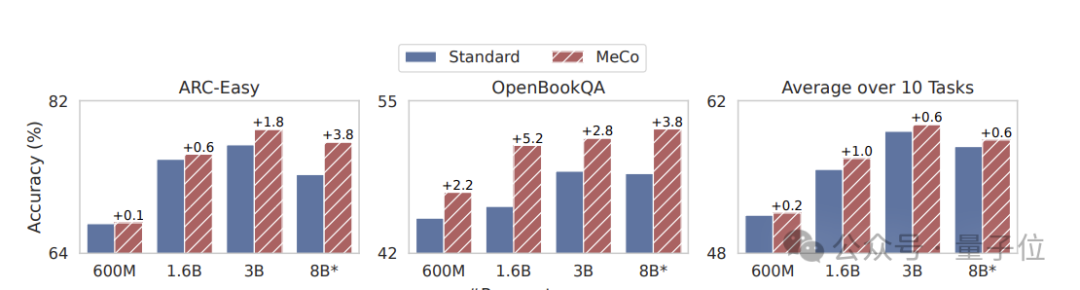

在不同模子范畴(600M - 8B)和考试数据开头的情况下,均能达成性能方面的普及。

天然之前元数传说念过许多,但一作高天宇暗意,他们是第一个展示它若何影响卑劣性能,以及具体若何实施以确保推理中具备多量实用性。

来望望具体是若何作念到的吧?

元数据加速大模子预考试

说念话模子预考试语料库中存在着格调、规模和质料水平的庞杂各异,这关于开采通用模子能力至关热切,然而高效地学习和部署这些异构数据源中每一种数据源的正确步履却极具挑战性。

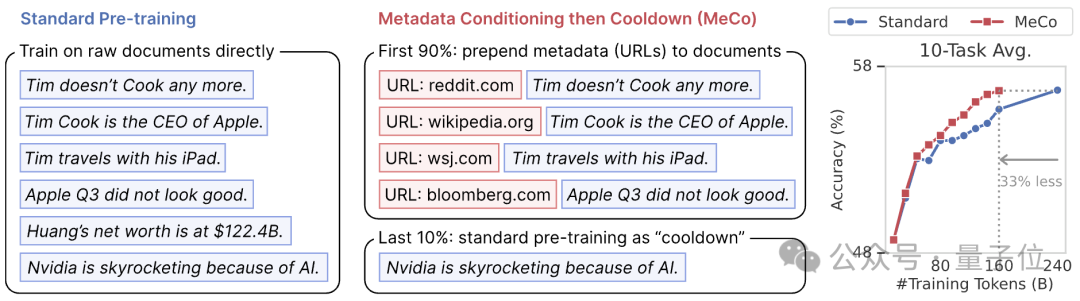

在这一配景下,他们提倡了一种新的预考试要领,称为元数据转念然后冷却(MeCo,Metadata Conditioning then Cooldown)。

具体包括两个考试阶段。

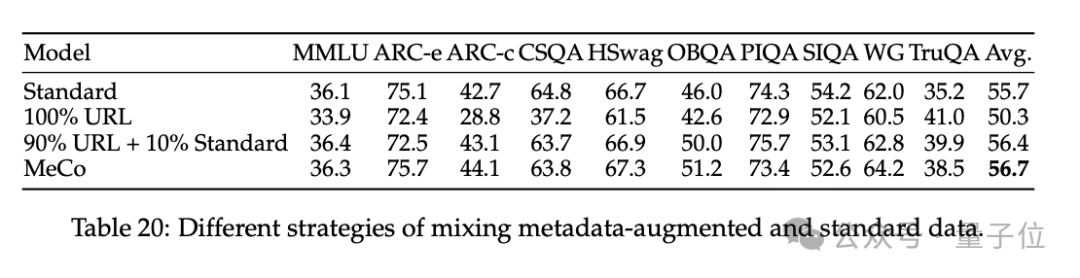

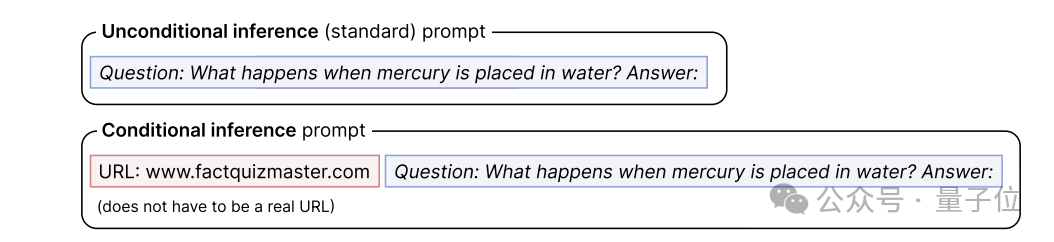

预考试阶段(90%),将元数据(如文档 URL 的王人备域名c)与文档拼接(如 “URL: en.wikipedia.org [document]”)进行考试。

(举例,若是文档的 URL 是 https://en.wikipedia.org/wiki/Bill Gates,那么文档 URL 的王人备域名c等于 en.wikipedia.org;这种 URL 信息在许多预考试语料库中都很容易获取,它们大多来自 CommonCrawl2(一个洞开的蚁集持取数据存储库))

当使用其他类型的元数据时,URL 应替换为相应的元数据称呼。

他们只狡计文档象征的交叉熵失掉,而不商酌模板或元数据中的象征,因为在初步执行中发现,对这些象征进行考试会稍许毁伤卑劣性能。

终末10%的考试模范为冷却阶段,使用模范数据考试,收受元数据转念阶段的学习率和优化器状况,即从上一阶段的终末一个检查点早先化学习率、模子参数和优化器状况,并不绝凭据蓄意诊疗学习率:

1)禁用跨文档Attention,这既加速了考试速率(1.6B 模子的考试速率提高了 25%),又提高了卑劣性能。

2)当将多个文档打包成一个序列时,咱们确保每个序列从一个新文档早先,而不是从一个文档的中间早先—当将文档打包成固定长度时,这可能会导致一些数据被丢弃,但事实诠释这故意于提上卑劣性能。

本次执行使用了Llama Transformer架构和Llama-3 tokenizer。咱们使用四种不同的模子大小进行了执行:600M、1.6B、3B 和 8B,以及有关优化诞生。

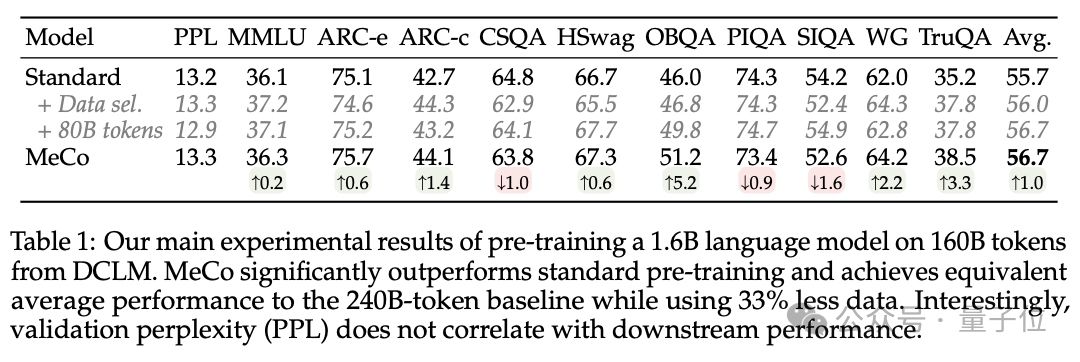

箝制显露,MeCo 的证据显然优于模范预考试,其平均性能与 240B 象征的基线特等,而使用的数据却减少了 33%。

终末追忆,他们主要完成了这三项孝敬。

1、 MeCo 大幅加速了预考试。

实考据明,MeCo 使一个 1.6B 的模子在少用 33% 的考试数据的情况下,达到了与模范预考试模子疏导的平均卑劣性能。在不同的模子范畴(600M、1.6B、3B 和 8B)和数据源(C4、RefinedWeb 和 DCLM)下,MeCo 显露出一致的收益。

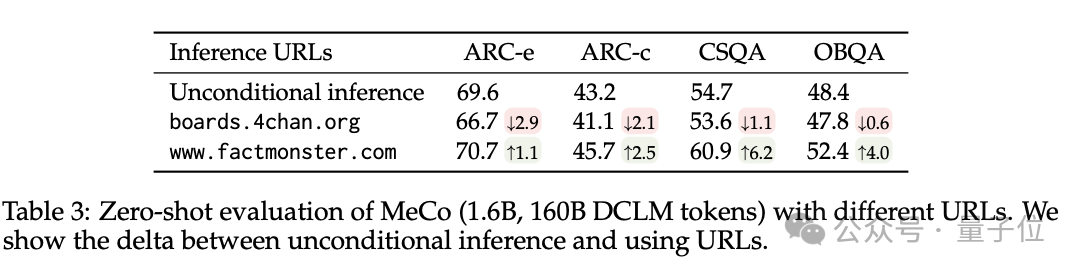

2、MeCo 开启了指挥说念话模子的新要领。

举例,使用factquizmaster.com(非着实URL)不错提高知识性任务的性能(举例,在零次知识性问题解答中王人备提高了6%),而使用wikipedia.org与模范的无要求推理比较,毒性生成的可能性裁减了数倍。

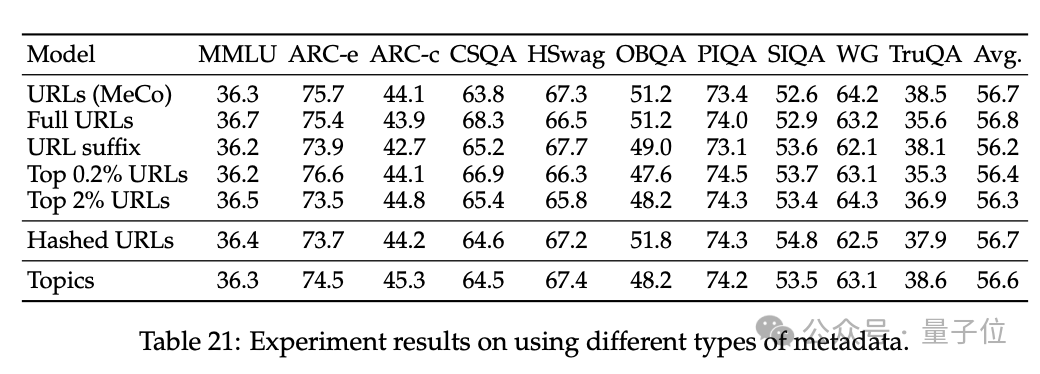

3、消解了 MeCo 的遐想遴荐,并诠释 MeCo 与不同类型的元数据兼容。

使用散列 URL 和模子生成的主题进行的分析标明,元数据的主要作用是按开头将文档归类。因此,即使莫得URL,MeCo 也能有用地整合不同类型的元数据,包括更轮廓的选项。

陈丹琦团队

论文作家来自普林斯顿NLP小组(附庸于普林斯顿说念话与智能PLI)博士生高天宇、Alexander Wettig、Luxi He、YiHe Dong、Sadhika Malladi以及陈丹琦。

一作高天宇,本科毕业于清华,是2019年清华特奖得主,当今普林斯顿五年纪博士生,瞻望本年毕业,不绝在学界搞商榷,商榷规模包括天然说念话责罚和机器学习的交叉规模,特等表情大说念话模子(LLM),包括构建期骗模范、提高LLM功能和箝制。

Luxi He当今是普林斯顿狡计机专科二年纪博士生,当今商榷重心是集结说念话模子并改善其一致性和安全性,硕士毕业于哈佛大学。

YiHe Dong当今在谷歌从事机器学习商榷和工程责任,专注于结构化数据的暗意学习、自动化特征工程和多模态暗意学习,本科毕业于普林斯顿。

— 完 —新澳门六合彩开奖网址